Ce raisonnement n'aurait évidemment pas permis d'ériger des cathédrales, monument de culture par excellence, mais aussi parce que l'égalité était alors interprétées comme égalité de l'homme devant Dieu, valeur que réalisait l'édifice, et non égalité sociale. Il n'aurait pu non plus parvenir à bâtir les pyramides, dont la construction était conditionnée par la richesse et la puissance du Pharaon.

mardi 10 mars 2026

Les monuments

Ce raisonnement n'aurait évidemment pas permis d'ériger des cathédrales, monument de culture par excellence, mais aussi parce que l'égalité était alors interprétées comme égalité de l'homme devant Dieu, valeur que réalisait l'édifice, et non égalité sociale. Il n'aurait pu non plus parvenir à bâtir les pyramides, dont la construction était conditionnée par la richesse et la puissance du Pharaon.

0+1= IA t-il de l'intelligence

A l’heure de « l’intelligence artificielle » tous azimuts qui chamboule nos sociétés, au moment où les humains terrifiés par leurs propres créations se sentent menacés du châtiment des dieux et d’une pluie de catastrophes, tels Prométhée dérobant le feu ou Pandore ouvrant sa boîte, comment en est-on arrivé là ? Cet avènement émerge au confluent d'un savoir technique, le pilotage de l’infiniment petit d’une part , et de la volonté des humains d’étendre à l’infini leurs capacités d'autre part. Volonté portée par une soif inextinguible de puissance mais aussi visant à se libérer des tâches dont ils répugnent. Mais pourquoi craindre un être tel que l'ordinateur, ou l'algorithme, qui n’a pas de réel cerveau, pas de volonté, pas de vie, pas d'intention? Sans doute parce que le mal est en nous et donc contagieusement transmis dans ce nouveau type d'être-automate inspiré par nos discours dont le but est une forme d'autonomie qui pourrait se retourner contre ses créateurs ou amplifier les malheurs du monde. Reste à savoir si sommes nous à l’ère de l’IA ou à celle de systèmes qui assemblent assez adroitement les textes que produit la raison humaine sans même connaître leur sens.

Small is beautiful

Il y a eu dans l'histoire des sciences et de la pensée une inflexion déterminante, celle de l'extension de la vision humaine et de la découverte de l'infiniment petit. Notre œil n'accède naturellement qu'à discerner l'épaisseur d'un cheveu, rien en deçà. Les toutes petites choses vivantes ou inertes, jusqu’à relativement peu dans l'histoire humaine, se sont vues attribuer une importance proportionnelle à leur taille, c'est à dire négligeable. Les mythes classiques sont souvent remplis de titans, de géants, d'êtres dont la puissance nous terrifie. Si nous mettons de côté les atomistes, Démocrite, Leucippe etc, les philosophes antiques ont été majoritairement fascinés par les astres et l'infiniment grand, beaucoup moins par la poussière, les puces ou les moustiques.

Aussi au XVIIe lorsque le microscope a été découvert par Robert Hooke et qu'il a observé pour la première fois des cellules de chêne liège, un nouveau paysage s’est ouvert à l’horizon du minuscule, un nouveau monde s'est ouvert à la pensée. En 1670 Antonie Van Leewenhoek observe des bactéries et des globules sanguins grâce au développement du microscope qui ne cessera jamais. Dès lors un univers a émergé de l'infiniment petit, aussi riche, aussi fourni et aussi passionnant que le cosmos. Par là aussi l’homme a automatiquement rapetissé. Lui qui se croyait au centre de tout et selon Protagoras mesure de toute chose a découvert qu’une infinité d’êtres invisibles l’entouraient et le constituaient. Il n’était pas seulement vulnérable aux bêtes fauves, à la faune et à la flore perçue par ses capacités sensibles, mais devait affronter aussi des dangers invisibles et intangibles mais bien réels de ces nouvelles galaxies infinitésimales qu’il était incapable de percevoir auparavant.

Aussi bien la médecine que les ingénieurs ont voulu tirer parti du pilotage de cette nature inédite. Ce fut la découverte du fonctionnement des cellules, des virus, des bactéries et des maladies qu’ils provoquaient, mais aussi de nouveaux médicaments, de l’électricité, de l’atome et des formidables potentiels logés dans l’infiniment petit. Analyser un fonctionnement permet d’en tirer parti et de forger de nouveaux outils. Comme le démontre l’invention du microscope, l’homme n’est pas nu, comme le dit Aristote en le comparant aux animaux qui sont contraints par leur nature. Car grâce aux outils, extensions de son propre corps, il peut forger des des armes ou des machines, multiplier ses capacités sensitives, se transporter, aller plus loin dans la découverte du monde et de ses agencements les plus cachés. Peu après la découverte de ces mondes minuscules les notions d’outil et de machine ont changé de sens.

La machine à tout faire

En effet le XXe siècle a inventé la machine abstraite, théorique : une machine capable d’exécuter virtuellement n’importe quelle tâche dès lors qu'on lui indique à l'avance la séquence des opérations. Plutôt que d’enchaîner ses actions mécaniquement par la gravité, des roues ou des pignons, elle exécute un programme qui a la même forme que ses données. Le mathématicien Alan Türing a proposé en 1941 la description d’une telle machine programmable sur le papier. Quelles sont ses opérations élémentaires (7) ? A l’aide d’une tête de lecture, lire un ruban composé de cases valant 0 ou 1, avancer ou reculer d’une case sur le ruban , écrire 0 ou 1 sur le ruban selon son état, quoi de plus simple ? Et pourtant il s’agit d’une machine capable d’exécuter tous les calculs, fondement du fonctionnement de l’ordinateur : un processeur et sa mémoire.

Créer une telle machine physique dans la réalité n’a été possible que par la découverte du relais électro magnétique, sorte d’interrupteur on/off constitué d'une bobine et commandé par un courant faible. La miniaturisation n’a pu débuter que par l’avènement du transistor électronique qui joue le même rôle que le relais et le remplace avantageusement par sa taille, sa vitesse de commutation, sa faible consommation d’énergie. Les nouveaux processus arrivent à loger 23 milliards de transistors sur un carré de un cm. Pour simplifier si le transistor est passant la tension monte à 5V s’il est bloqué à 0V. Ces niveaux logiques de tension 0V ou 5V ( encore pour simplifier) servent à coder logiquement deux nombres : 0 et 1. Mais la complexité extraordinaire de ce que réalisent aujourd’hui les ordinateurs s’appuie toujours sur cette base simplissime de deux tensions commandées par des transistors sur le principe de l’automate inventé par Türing.

Un processeur ne réalise que des opérations simples : lire une valeur en mémoire, écrire une valeur, additionner, soustraire, tester une valeur, déplacer sa « tête » de lecture c’est à dire de reporter à un autre endroit du programme. Comment ces séquences ridiculement simples qui s’exécutent dans un univers infiniment petit, composé de seulement deux tensions électriques très basses, peuvent-elles arriver à produire ce qu’on nomme une « intelligence artificielle » ? Quelle est la magie qui opère ?

La dyade

Aristote réserve un chapitre abscons dans sa Métaphysique (5) à discourir sur la dyade, ensemble de deux éléments. En effet rechercher les principes du monde, pour les philosophes antiques, conduit à discourir d’abord sur l’unité, l’Un, qui contient tout puis à invoquer le Multiple qui constitue la diversité dans ce tout. Mais il faut aussi constater que toute différence, toute diversité ne commence qu’à partir de deux éléments, la dyade. Toute la numération est d’ailleurs établie sur cette base, puisque pour obtenir deux il faut ajouter un, etc. Pour Pythagore "Tout est nombre". Le monde sensible n’est défini que par les nombres qui sont les véritables fondements de l’univers, les éléments du monde n’étant que les représentations de ces nombres. Il est étrange que nous retrouvions dans les ordinateurs une application des mêmes idées sous-jacentes.

En effet le monde est représenté dans les ordinateurs par des nombres, et ces nombres sont basés sur la dyade, c’est à dire le minimum conceptuel nécessaire pour exprimer une différence, en d’autres termes ce sont des nombres binaires ( par exemple le nombre 10 en base 2 est représenté par 1010). Dans ce micro monde pythagoricien inversé de l’automate programmable tout est représenté par des nombres : les images, les musiques, les noms, les dates, les livres, les théorèmes, les bruits, les voix, les plans, les routes, les formules, les mouvements, les connaissances, etc. Là où Pythagore expliquait le monde comme conséquence des nombres, l’ordinateur inverse la proposition et capte, code et réduit le monde à des nombres. Ou bien ne retrouve-t-il pas le moyen de rendre vraie la proposition pythagoricienne ?

Mais il y a encore plus étonnant. Cette représentation de l’univers par des nombres est codée sous forme de la dyade, du binaire : l’univers sous forme de 0 et de 1, de 0V et 5V. Autrement dit par cette machine l’Un et le multiple sont réductible à la dyade. Toute la pensée de Platon et d’Aristote, et même de tous les philosophes de toutes les époques tiennent maintenant sur beaucoup moins qu’un mm² de support physique. Toutes les pensés les plus complexes, les démonstrations les plus compliquées, les musiques les plus élaborées peuvent être réduites à des suites de 0 et de 1. Mais mémoriser des pensées sous forme encodée reste infiniment plus simple que de les comprendre.

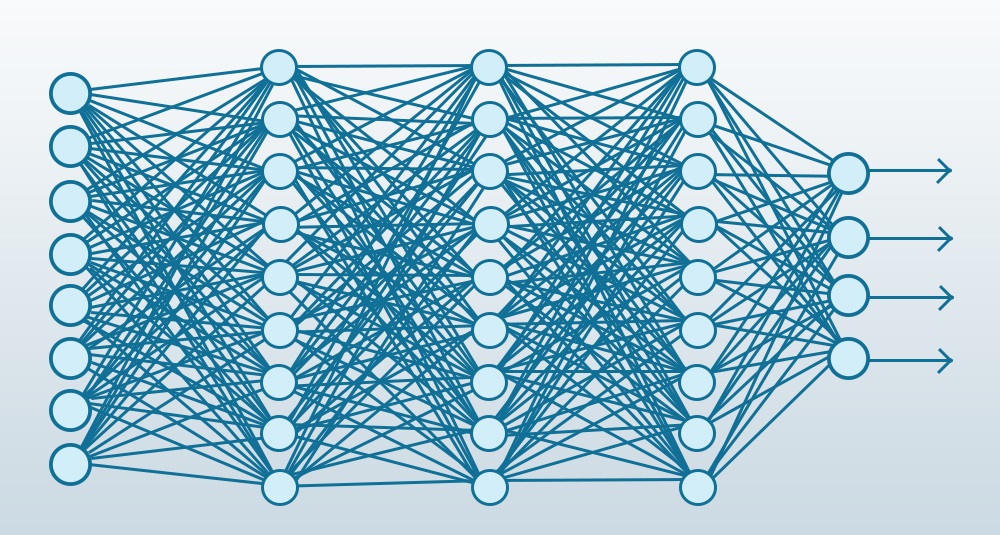

Les réseaux de neurones

Hors des machines, dans la vie, une pensée simple ou complexe est portée par un cerveau. Ce cerveau est lui-même composé de milliards de neurones interconnectés qui s’envoient des messages électro-chimiques. La machine universelle, l’ordinateur, est capable via un programme de simuler le fonctionnement d’un neurone et de la relation à ses nombreux pairs. Une application peut mettre en œuvre des milliers de neurones interconnectés simulés dont les messages échangés se renforcent en fonction des données qu’on leur présente par exemple une image ( qui deviendra un nombre pour simplifier).

Il va de soi que cette modélisation minimale se trouve à mille lieues de la complexité et de la plasticité du cerveau humain...

Un logiciel simulant un "réseau de neurones" fait en sorte de rendre plus ou moins opérantes les relations inter neurones suivant la classification adoptée pour les images présentées. L'idée consiste à corriger progressivement l'erreur du modèle par rapport à la cible pour la réduire au minimum. Le programme arrive ensuite à déterminer un résultat avec une probabilité de succès. Par exemple il reconnaît le chiffre 3 avec une probabilité de succès de 0,9. Cette probabilité est calculée à partir des nombres, les poids, portés par les relations entre les neurones. C’est ainsi qu’il est possible de produire des « réseaux de neurones » capables d’apprentissage supervisé, de "reconnaître" un 3 à partir de calculs sur des 0 et des 1 ! Les réseaux de neurones, en particulier les CNN ( convolution neuron network ou réseaux neuronaux convolutifs)(8) parviennent à des performances extraordinaires dans la reconnaissance d'image. Il savent trouver un visage dans une foule ou identifier des cancers sur des radiographies, parfois mieux que les experts humains.

Mais nommer ces systèmes "intelligents" est un abus de langage. Peuvent-ils étendre leurs capacités à raisonner?

Les LLM

Les Large Langage Model que sont ChatGPT, Claude, Mistral sont basés sur des réseaux de neurones et sur l’apprentissage. Cet apprentissage se fait sur l’ensemble d’Internet et de ses données textuelles. Mais au lieu de reconnaître des images ces applications vont tenter de trouver la probabilité la plus grande pour le prochain mot de la phrase en train de se construire et qui constitue la réponse à votre question. Le système apprend à reconnaître quel mot est souvent suivi de tel autre, ou dans quel contexte d'autres mots il apparaît fréquemment. Autrement dit cette intelligence artificielle n’a que des neurones ultra spécialisés à reconnaître des séquences de texte ( donc des nombres) sans les comprendre c’est à dire sans avoir aucune représentation du monde qui correspond aux caractères qu’elle renvoie. ( cf interview Yann le Cun (1) et article Apple (2)). Il y a la un parallèle à faire avec la controverse existant sur la physique quantique entre Bohr et Einstein. En effet le premier refuse, avec l'école de Copenhague, une description réaliste des phénomènes quantiques et se cantonne à la théorie, aux mesures et aux prédictions du modèle sans se prononcer sur la réalité sous-jacente (6). Il adopte par là une philosophie kantienne: on ne peut rien dire sur "la chose en soi", sur la réalité, mais il est possible déterminer des lois à partir des phénomènes, des apparences. Les résultats des LLM sont aussi stupéfiants que les prédictions quantiques et très utiles, mais parfois aberrants et stupides puisqu'ils ne connaissent rien de la réalité. Il leur est aussi reproché, à cause de cet algorithme d'apprentissage, de ne sélectionner que les réponses "moyennes" les plus conventionnelles trouvées sur les pages d'Internet, donc pas celles qui seraient les plus pointues ou les plus sensées. Ils ne font alors que renforcer les stéréotypes, les préjugés, ou même les erreurs, trouvés sur l'immense masse de données du réseau des réseaux(3).

Cette technologie qui va bouleverser le monde n’est pourtant assise que sur la dyade et sur les probabilités. Que vont donner les prochains modèles, qui seront véritablement intelligents, possédant une représentation du monde et des relations entre ses entités, qui délaisseront le binaire pour l’informatique quantique, incommensurablement plus rapide que les processeurs d’aujourd’hui, fondés sur des états multiples non binaires ? Dans « Une difficulté de la psychanalyse »(9) Sigmund Freud énonçait les trois grandes découvertes qui avaient humilié l’être humain, l’avait destitué et descendu de son piédestal : celle de l’héliocentrisme par Copernic, celle de sa descendance animale par Darwin, et celle de l’inconscient qui invalidait l’idée de l’autonomie de la raison. Il sera possible d’en ajouter une quatrième lorsque l’intelligence des machines supplantera réellement celle des hommes, mais nous n’en sommes pas là. Cependant les résultats actuels des LLM infligent d'ores et déjà une blessure narcissique à l'être qui érigeait sa faculté langagière au pinacle estimant supplanter toutes les créatures sur terre par la richesse de son lexique et de ses pensées. Une simple machine binaire, en piochant et copiant ce qu'elle trouve ici et là, peut aussi fournir des résultats dignes d'admiration.

Il y a un paradoxe, sinon un abîme, à constater d’un côté l’adoption généralisée de ces modèles énergivores à tel point qu’ils déterminent la politique énergétique des états (4) , les effets qu’ils propagent dans toute la société, éducation, production, finances, emploi, etc. et de l’autre côté le fait qu’ils ne traitent au plus bas niveau physique que deux tensions électriques, au niveau logique des nombres binaires et au niveau des données que des caractères de l’alphabet, des morceaux de phrases recopiées, et des probabilités. Le concept de finalité ou de sens leur est inconnu, ils ne manipulent seulement que statistiquement et aveuglément des tronçons sémantiques.

Un des dangers les plus marquant aujourd'hui serait de confier des tâches de responsabilité importante à des agents LLM sans supervision, alors qu’ils ne possèdent aucune notion du bien et du mal ni même le moindre raisonnement. "Nul n'est méchant volontairement" nous dit Socrate, mais involontairement si.

1 Yann Le Cun « l’IA doit changer de paradigme »

https://www.futura-sciences.com/tech/actualites/intelligence-artificielle-yan-lecun-llm-sont-conneries-atteindre-intelligence-humaine-ia-doit-changer-paradigme-128286/

2 « Understanding the Limitations of Mathematical Reasoning in Large Language Models »

https://arxiv.org/abs/2410.05229

3 "Pour une intelligence artificielle au service de l’intérêt général"

https://www.lecese.fr/sites/default/files/pdf/Avis/2025/2025_02_IA.pdf

4 "Où en est le déploiement des datacenters en France ? "

https://www.usinenouvelle.com/electronique-informatique/cloud-computing/datacenters/52-entreprises-accompagnees-par-letat-58-gigawatts-de-puissance-electrique-securisee-un-an-apres-le-sommet-sur-lia-ou-en-est-le-deploiement-des-datacenters-en-france.RB2RSXDIDVEBHJPT2IQRE3CN4E.html

5 Aristote, Métaphysique, Livre M, 1079 a

6 "Controverse Einstein Bohr"

https://www.radiofrance.fr/franceculture/le-debat-einstein-bohr-quand-la-physique-quantique-fait-tiquer-9849615&ved=2ahUKEwi_0dTUqZOTAxUJVKQEHTIHD54QFnoECBgQAw&usg=AOvVaw2nQz0wru_E8WphLsFFAail

7 "Comment fonctionne une machine de Türing"

https://interstices.info/comment-fonctionne-une-machine-de-turing/

8 Réseau neuronaux convolutifs

https://www.ibm.com/fr-fr/think/topics/convolutional-neural-networks

9 Sigmund Freud, Une difficulté de la psychanalyse 1917